Autokorrelation

Die Autokorrelation (auch Kreuzautokorrelation[1]) ist ein Begriff aus der Stochastik und der Signalverarbeitung und beschreibt die Korrelation einer Funktion oder eines Signals mit sich selbst zu einem früheren Zeitpunkt. Korrelationsfunktionen werden für Folgen von Zufallsvariablen berechnet, die von der Zeit abhängen. Diese Funktionen geben an, wie viel Ähnlichkeit die um die Zeit verschobene Folge mit der ursprünglichen Folge hat. Da die unverschobene Folge mit sich selbst am ähnlichsten ist, hat die Autokorrelation für die unverschobene Folge den höchsten Wert. Wenn zwischen den Gliedern der Folge eine Beziehung besteht, die mehr als zufällig ist, hat auch die Korrelation der ursprünglichen Folge mit der verschobenen Folge in der Regel einen Wert, der signifikant von Null abweicht. Man sagt dann, die Glieder der Folge sind autokorreliert.

Da die Folge mit einer verschobenen Version ihrer selbst verglichen wird, spricht man von einer Autokorrelation. Werden hingegen zwei verschiedene Folgen und verglichen, spricht man von einer Kreuzkorrelation. Mit der Autokorrelation ist es möglich, Zusammenhänge zwischen den beobachteten Ergebnissen zu verschiedenen Beobachtungszeitpunkten einer Messreihe festzustellen. Die Kreuzkorrelation gibt dagegen die Korrelation zwischen verschiedenen Merkmalen in Abhängigkeit von der Zeit an.

In der Signalverarbeitung geht man häufig auch von kontinuierlichen Messdaten aus. Man spricht von Autokorrelation, wenn die kontinuierliche oder zeitdiskrete Funktion (z. B. ein- oder mehrdimensionale Funktion über die Zeit oder den Ort) mit sich selbst korreliert wird, beispielsweise mit . Mit dem Durbin-Watson-Test kann anhand einer Stichprobe überprüft werden, ob eine Zeitreihe oder räumliche Daten eine Autokorrelation aufweisen.

Die Autokorrelation wird in den verschiedenen Disziplinen unterschiedlich definiert. In der Statistik wird sie für stochastische Prozesse als normierte Form der Autokovarianz berechnet, in der Signalverarbeitung als Faltung des zeitabhängigen Signals mit sich selbst. In manchen Gebieten werden die Begriffe Autokorrelation und Autokovarianz auch synonym verwendet.

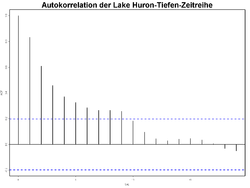

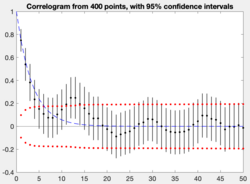

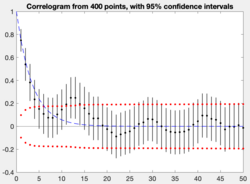

In einem Korrelogramm kann die geschätzte Autokorrelation inklusive Konfidenzintervallen grafisch dargestellt werden und so schnell die statistische Signifikanz einer geschätzten Autokorrelation bewertet werden. Alternativ kann auch der Portmanteau-Test zum Test auf Autokorrelation verwendet werden.

Autokorrelation in der Stochastik

In der Stochastik beschreibt die Autokovarianzfunktion oder Kovarianzfunktion die Kovarianz zwischen den Zufallsvariablen eines reellwertigen stochastischen Prozesses mit zwei verschiedenen Indizes (z. B. Zeitpunkten im Fall ).

Definition

Für einen reellwertigen stochastischen Prozess mit endlichen Varianzen, d. h. für alle , heißt die Funktion ,

(Auto-)Kovarianzfunktion des stochastischen Prozesses. Hierbei bezeichnet den Erwartungswert und den Erwartungswert von . Die Existenz und Endlichkeit dieser Erwartungswerte ergibt sich aus der Endlichkeit der Varianzen. Für ist die Autokovarianz identisch mit der Varianz, d. h. .

Für einen reellwertigen stochastischen Prozess mit , der schwach stationär (stationär im weiteren Sinn) ist, sind die Größen Erwartungswert, Standardabweichung und Varianz der Zufallsvariablen für nicht zeitabhängig. Die Autokovarianzen sind dann nicht von der Lage der Zeitpunkte und , sondern nur von der Zeitdifferenz zwischen und abhängig, es gilt also

wobei für alle .

Die Autokorrelationsfunktion des stochastischen Prozesses wird, falls dieser positive Varianzen für alle Zeitpunkte besitzt, definiert als normierte Autokovarianzfunktion:

- Hierbei bedeuten:

| Standardabweichung von | |

| Standardabweichung von | |

| Autokorrelation bezogen auf die Zeitpunkte und |

In dieser Form ist die Autokorrelationsfunktion einheitenlos und auf den Bereich zwischen −1 und 1 normiert.

Für einen stationären Prozess ist die Autokovarianz nur vom Zeitunterschied zwischen und abhängig. Die Standardabweichung ist dann unabhängig vom Zeitpunkt, das Produkt der Standardabweichungen im Nenner entspricht dann der von unabhängigen Varianz . Somit vereinfacht sich die Autokorrelationsfunktion für einen stationären Prozess zu:

- ,

da gilt.

Eigenschaften der Autokorrelationsfunktion

bezeichne einen reellwertigen stochastischen Prozess mit . Falls der Prozess stationär im weiteren Sinn ist, wird im Folgenden vom stationären Spezialfall gesprochen.

- Für die Autokorrelationsfunktion gilt

- Die Aukorrelationsfunktion ist also – im Unterschied zur Autokovarianzfunktion – normiert, in dem sie nur Werte im Intervall annehmen kann.

- Im stationären Spezialfall gilt .

- Es gilt

- Im stationären Spezialfall gilt .

- Die Autokorrelationsfunktion hat die Symmetrieeigenschaft

- Im stationären Spezialfall gilt .

- Falls für alle gilt, ist

- die Konzepte der Korrelations- und der Kovarianzfunktion fallen in diesem Spezialfall also zusammen.

- Im stationären Spezialfall gilt .

- Falls alle Zufallsvariablen standardisiert sind, also ein Prozess mit und für alle vorliegt, gilt

- Im stationären Spezialfall gilt .

Schätzung

Analog zur Stichprobenkovarianz und Stichprobenkorrelation können auch die Stichprobenautokovarianz bzw. die Stichprobenautokorrelation bestimmt werden. Liegen die Daten vor, die als Realisierung eines (im weiteren Sinn) stationären stochastischen Prozesses aufgefasst werden können, so werden die unkorrigierten azyklischen[2] Stichprobenautokovarianzen üblicherweise durch

berechnet, wobei . Zu beachten ist hier die Konvention, die Summe durch statt durch zu teilen, um zu garantieren, dass die Folge der Stichprobenautokovarianzen positiv semidefinit ist.[3] Für erhält man die unkorrigierte Stichprobenvarianz der Daten.

Die Stichprobenautokorrelation ergibt sich dann durch

mit . Die Berechnung der Standardfehler von Stichprobenautokorrelationen erfolgt meist anhand der Bartlett-Formel (siehe dazu: Korrelogramm).

Um die unverzerrte azyklische Stichprobenautokorrelation zu berechnen, teilt man stattdessen durch :[2]

Die unverzerrte azyklische Stichprobenkorrelation kann auf modernen Computern schneller im Fourierraum mithilfe der diskreten Fourier-Transformation ausgerechnet werden (siehe auch Wiener-Chintschin-Theorem), indem das (um den Mittelwert bereinigte) Signal mit Nullen verlängert („Zero Padding“). Die angehängten Nullen bewirken, dass nicht die zyklische Stichprobenkorrelation berechnet wird (welche ein periodisches Signal annimmt), sondern die azyklische Stichprobenkorrelation:[2]

Anwendungen

Genutzt wird die Autokorrelation u. a. in der Regressionsanalyse zeitlicher Daten, in der Zeitreihenanalyse und in der Bildverarbeitung. Beispielsweise werden in der Regressionsanalyse die Störgrößen, also die Abweichungen der Beobachtungswerte von der wahren Regressionsgeraden, als Folge von identisch verteilten Zufallsvariablen interpretiert. Damit die Regressionsanalyse sinnvolle Ergebnisse liefert, müssen die Störgrößen zeitlich unkorreliert sein (was z. B. mit dem Portmanteau-Test kontrolliert werden kann). In der Zeitreihenanalyse wird die Autokorrelationsfunktion zusammen mit der partielle Autokorrelationsfunktion häufig zur Identifikation von ARMA-Modellen verwendet.

Verallgemeinerungen

Es gibt ein analoges Konzept für komplexwertige stochastische Prozesse mit Realisierungen , wobei für gilt und die Menge der komplexen Zahlen bezeichnet.[4] Wenn der Prozess endliche Varianzen besitzt, dann heißt die Funktion ,

die Kovarianzfunktion des Prozesses . Dabei ist für eine komplexwertige Zufallsvariable der Erwartungswert als definiert und die komplexwertige Zufallsvariable bezeichnet die konjugiert komplexe Variable zu .

Wenn alle Varianzen positiv sind, ist ,

die Korrelationsfunktion (oder Autokorrelationsfunktion) des Prozesses.

Autokorrelation in der Signalverarbeitung

Definition

Hier wird die Autokorrelationsfunktion (AKF) zur Beschreibung der Korrelation eines Signales mit sich selbst bei unterschiedlichen Zeitverschiebungen zwischen den betrachteten Funktionswerten eingesetzt.[5] Die AKF des Signals lässt sich sowohl symmetrisch um den Nullpunkt herum definieren:

- ,

als auch asymmetrisch:

- ,

Das Ergebnis würde sich in letzterem Falle z. B. bei einer Dirac-Funktion bei auf Grund dessen Symmetrie unterscheiden.

In Kurzschreibweise wird für die Autokorrelation das Operatorsymbol verwendet:

mit als die konjugiert komplexe Funktion von und dem Faltungsoperator .

Die AKF entspricht der Autokovarianzfunktion für mittelwertfreie, stationäre Signale. In der Praxis wird die Autokorrelationsfunktion solcher Signale in der Regel über die Autokovarianzfunktion berechnet.

Für zeitdiskrete Signale wird statt des Integrals die Summe verwendet. Mit einer diskreten Verschiebung ergibt sich:

In der digitalen Signalanalyse wird die Autokorrelationsfunktion in der Regel über die inverse Fouriertransformation des Autoleistungsspektrums berechnet:

Die theoretische Grundlage dieser Berechnung ist das Wiener-Chintschin-Theorem.

Impuls-AKF

Für Signale mit endlichem Energieinhalt – sogenannte Energiesignale – erweist es sich als sinnvoll, folgende Definition zu verwenden:

- .

Eigenschaften der AKF

Geradheit

Die AKF ist eine gerade Funktion:

- .

Periodizitäten

Die einer periodischen AKF () zugrundeliegende Funktion ist selbst periodisch, wie folgender Beweis zeigt:

| . |

Umgekehrt gilt auch für periodische Funktionen , dass ihre AKF periodisch ist:

| . |

Somit lässt sich schließen, dass eine Funktion und ihre AKF stets dieselbe Periodizität aufweisen:

- .

Gibt es Wiederholungen im Signal, so ergeben sich Maxima der Autokorrelationsfunktion bei den Zeitverschiebungen, die der Wiederholungsdauer von Erscheinungen im Signal entsprechen. So können z. B. versteckte periodische Anteile und Echoerscheinungen in Signalen detektiert werden.

Maximum

Die AKF hat unabhängig ihrer Definition bei ihr Maximum:[6]

Für die AKF wird dieser Wert als Effektivwertquadrat, für die Impuls-AKF als Signalenergie bezeichnet.

Häufig wird die Autokorrelationsfunktion auch auf den Maximalwert bei normiert angegeben:

Der Betrag dieser normierten Autokorrelationsfunktion kann Werte zwischen 0 und 1 annehmen. Man spricht dabei auch vom zeitlichen Autokorrelationskoeffizienten einer Zufallsvariablen mit der zeitlich verschobenen Zufallsvariablen .[7]

Abfallverhalten

Für große Zeiten und nicht selbst periodische Funktionen x gilt:

- .

Beispiele

Beispiel 1

Die Funktionen im nebenstehenden Bild sind aus sinusförmigen Abschnitten einheitlicher Frequenz zusammengesetzt. An den Stoßstellen treten Phasensprünge auf. Zur Berechnung der Korrelation multipliziert man punktweise beide Signalwerte und addiert die Produkte über einen längeren Zeitraum. Bei der gezeichneten Verzögerung Δs sind in den rot markierten Bereichen alle Einzelprodukte positiv oder null, in den dazwischen liegenden Bereichen meist negativ. Nur für Δs = 0 sind alle Einzelprodukte positiv, die Korrelationsfunktion erreicht ihren maximalen Wert.

Nebenbemerkung: Addiert man beide Signale, können stückweise konstruktive bzw. destruktive Interferenz auftreten.

Beispiel 2

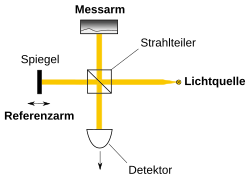

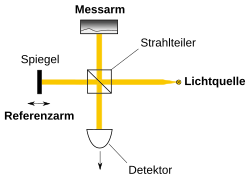

Bei der Optischen Kohärenztomografie wird Licht besonders geringer Kohärenzlänge verwendet, weil die Autokorrelation nur dann ein merklich von Null abweichendes Ergebnis liefert, wenn die Länge von Messarm und Referenzarm gut übereinstimmen. Bei größerer Abweichung variieren die Ergebnisse der Autokorrelation um Null (Weißlichtinterferometrie).

Anwendungen in der Signalverarbeitung

Finden von Signalperioden

Eine häufige Anwendung der Autokorrelationsfunktion besteht darin, in (gegebenenfalls trendbereinigten) stark verrauschten Signalen Periodizitäten zu finden, die nicht ohne weiteres ersichtlich sind:

- Die Autokorrelationsfunktion eines periodischen Signals ist wieder ein periodisches Signal mit derselben Periode. So ist zum Beispiel die Autokorrelationsfunktion eines Kosinussignals

- wiederum eine Kosinusfunktion mit derselben Kreisfrequenz (Erhaltung der Signalperiode).

- ,

- Allerdings ist hierbei die Phaseninformation verloren gegangen.

- Eine gleichwertige Möglichkeit des Findens der Signalperiode ist die Möglichkeit, das Fourier-Spektrum des Signals nach einer dominanten Frequenz zu untersuchen. Da die Autokorrelation die normierte Fourier-Transformierte des Leistungsdichtespektrum ist (gemäß dem Wiener-Khinchine-Theorem), sind beide Ansätze gleichwertig.

- Da weißes Rauschen zu einem Zeitpunkt völlig unabhängig von weißem Rauschen zu einem anderen Zeitpunkt ist, ergibt die Autokorrelationsfunktion von weißem Rauschen einen Dirac-Impuls an der Stelle . Liegt weißes Rauschen der Leistungsdichte für die Frequenzen vor, so gilt:

Bei gefärbtem Rauschen, das in technischen Systemen meistens an Stelle von weißem Rauschen vorkommt, ergibt sich ebenso ein absolutes Maximum der Autokorrelationsfunktion bei und ein Abfall der Autokorrelationsfunktion für Verschiebungen . Die Breite dieses Maximums wird von der „Farbe“ des Rauschens bestimmt.

Bei der Analyse von Periodizitäten wird nur die Autokorrelationsfunktion für große Werte von betrachtet und der Bereich um ignoriert, da er vor allem Information über die Stärke des Rauschsignals enthält.

Signal-Rausch-Verhältnis

Da der Wert der Autokorrelationsfunktion bei dem quadratischen Mittelwert (bei Leistungssignalen) bzw. der Signalenergie (bei Energiesignalen) entspricht, kann man durch Bilden der Autokorrelationsfunktion relativ einfach das Signal-Rausch-Verhältnis abschätzen.

Dazu teilt man die Höhe des Wertes , d. h. den Wert, den die Autokorrelationsfunktion ohne Rauschen an der Stelle 0 hätte, durch die Höhe der „Rauschspitze“. Beim Umrechnen des Signal-Rausch-Verhältnisses Sx / Nx in Dezibel muss man darauf achten, dass man und nicht verwendet. Das liegt daran, dass die Autokorrelationsfunktion an der Stelle 0 eine Leistungs- bzw. Energiegröße (quadratische Größe) und keine Feldgröße darstellt.

Siehe auch

- Partielle Autokorrelationsfunktion

- Maximum Length Sequence

- Kreuzkorrelation

Literatur

- P. H. Müller (Hrsg.): Lexikon der Stochastik – Wahrscheinlichkeitsrechnung und mathematische Statistik. 5. Auflage. Akademie-Verlag, Berlin 1991, ISBN 978-3-05-500608-1, Kovarianzfunktion, S. 208–209.

Weblinks

- Autocorrelation. Wolfram MathWorld, abgerufen am 3. September 2013.

Einzelnachweise

- ↑ auf Englisch cross-autocorrelation, Google Books

- ↑ a b c Julius O. Smith: Unbiased Cross_Correlation. In: Mathematics of the Discrete Fourier Transform (DFT): With Audio Applications. ISBN 978-0-9745607-4-8, S. 188

- ↑ Peter J. Brockwell, Richard A. Davis: Time Series: Theory and Methods. Springer-Verlag, New York 1987, ISBN 0-387-96406-1, S. 28–29.

- ↑ P. H. Müller (Hrsg.): Lexikon der Stochastik – Wahrscheinlichkeitsrechnung und mathematische Statistik. 5. Auflage. Akademie-Verlag, Berlin 1991, ISBN 978-3-05-500608-1, Kovarianzfunktion, S. 208–209.

- ↑ Autokorrelationsfunktion (AKF) – LNTwww. In: Autokorrelationsfunktion (AKF). LNTwww (Technische Universität München), abgerufen am 19. Juli 2024.

- ↑ Autokorrelationsfunktion (AKF) – LNTwww. In: Autokorrelationsfunktion (AKF). LNTwww (Technische Universität München), abgerufen am 19. Juli 2024 (Eigenschaften der Autokorrelationsfunktion).

- ↑ Patrick F. Dunn: Measurement and Data Analysis for Engineering and Science. McGraw-Hill, New York 2005, ISBN 0-07-282538-3

Auf dieser Seite verwendete Medien

Doppelspaltversuch: Konstruktive Interferenz

Autor/Urheber:

- Comparison_convolution_correlation.svg: Cmglee

- derivative work: Wdwd

Grafischer Vergleich der Faltung, Kreuzkorrelation und Autokorrelation

Autor/Urheber: Muskid, Lizenz: CC BY-SA 3.0

Weißlichtinterferometrie und TD-OCT nach File:Interferometer-Prinzip.png

(c) Thomas Steiner, CC BY-SA 3.0

Autokorrelation einer Zeitreihe (Details siehe GNU R-Hilfe: "Annual measurements of the level, in feet, of Lake Huron 1875-1972."

R-Quelltext:

#LakeHuron ... Level of Lake Huron 1875-1972 png(filename = "Autokorrelation.png", width=1600, height=1200) par(bg="lightgrey",lwd=3) acf(LakeHuron,main="") title(main="Autokorrelation der Lake Huron-Tiefen-Zeitreihe",cex.main=3)dev.off()

(c) English Wikipedia Benutzer Hoemaco, CC BY-SA 3.0

Autocorrelation function of the Barker-7 binary code.

Autor/Urheber: Dicklyon, Lizenz: CC BY-SA 4.0

Correlogram example from 400-point sample of a first-order autoregressive process with 0.75 correlation of adjacent points, along with the 95% confidence intervals (plotted about the correlation estimates in black and about zero in red), calculated via the formulae in en:Correlogram#Statistical_inference_with_correlograms. The dashed blue line shows the actual autocorrelation function of the sampled process.